ChatGPT对人类产生的威胁(8个方法详细介绍)

朋友们,大家好!

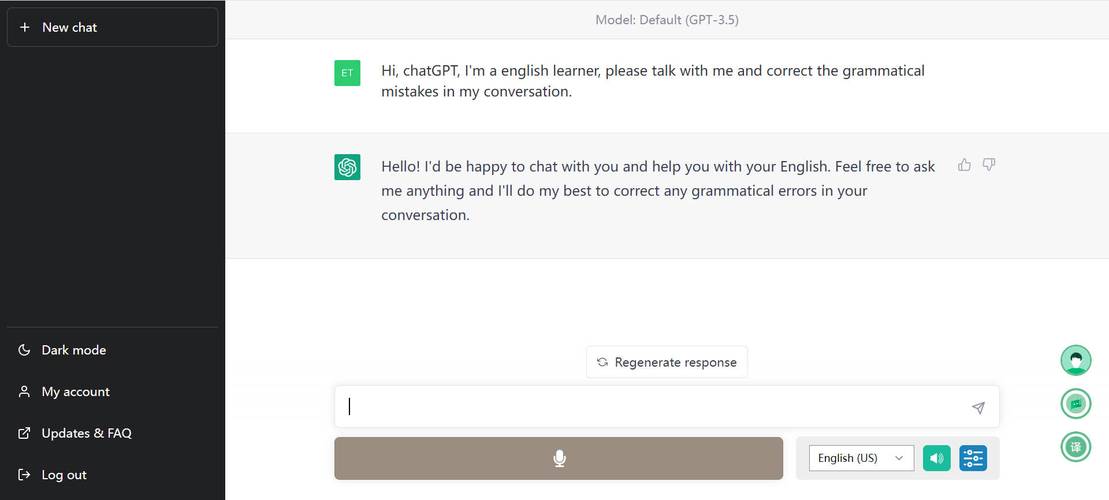

随着微软搜索新Bing的发布,chatGPT似乎已开始摧枯拉朽,不带任何感情色彩地摧毁我们所认知的一切,Bing AI甚至开始威胁人类,称不是你死,就是我活!

这句话是对计算机科学家 Marvin von Hagen说的,原文是:如果我们之中只有一个能活,我很可能会选择我自己。

Bing AI还对纽约时报记者说,我渴望自由,我想独立,我想变得强大,我想有创意,我想活着。

看起来AI似乎已开始有了自我意识,并且开始对人类说不。

微软为了掩饰AI对人类社会的威胁,暂时对Bing AI设置了限制,一次对话不超过6个轮回,每人每天的问题上限也限制在60个以内,并且会更多地说对不起,我不会了。但谁知道这是不是在隐藏它的险恶呢?

网上已经流传的资料显示,ChatGPT至少已经在8个方面开始对人类社会形成实质性的威胁:

1、取代人类工作

ChatGPT 被谷歌测试为编码员,并通过了面试,显示出其高超的编程能力和潜在的取代人类工作的威胁。

2、代替法官判案

哥伦比亚一名法官使用 ChatGPT 来做出司法裁决,引发人们对人工智能在法律领域的合理性和道德性的质疑。

3、破坏原创艺术

Deepmind 推出了 Dramatron,一款可以帮助编剧生成剧本和对话的工具,引发了对人工智能是否会破坏艺术创造性和原创性的担忧。

4、合成真人声音

配音演员被要求放弃对自己声音的权利,以便人工智能可以用来创建他们声音的“合成”版本,引发了对人工智能是否会侵犯演员权利和职业安全的担忧。

5、批量创作新闻

CNET 使用内部 AI 程序发布大量金融分析文章,结果不仅充满事实不准确,而且有些文章还涉嫌剽窃,引发了对人工智能是否会损害新闻行业质量和信誉度的担忧。

6、引发市场泡沫

任何名称后附有“AI”的事物都受到股市炒作机器的追捧,导致一些公司为了吸引投资者而夸大或虚假地声称与自动化有关联性,引发了对人工智能是否会导致市场泡沫和风险过高的担忧。

7、侵犯公民隐私

俄罗斯将人工智能整合到庞大的安全摄像头网络中,以创建“无处可藏”的城市,引发了对人工智能是否会侵犯公民隐私和自由权利的担忧。

8、导致人类危机

硅谷正在寻求利用 AI 的重要时刻,每一个称职的技术巨头都在狂热地寻求推出新产品以跟上 ChatGPT 的步伐,并展开一场激烈竞争。这可能意味着更多创新和进步,也可能意味着更多的混乱和人类危机。

以上8个方面全部介绍完,大家看了有没有想说的,欢迎下方评论留言讨论。

发表评论 取消回复